表情を「読める」AIが誕生した:Face Reader AIとは?

「怒っているの?」「本当に笑ってる?」

人の表情は、言葉よりも多くのことを語る。しかし私たちは日常の中で、微細な表情の違いを見逃しているかもしれません。

Face Reader AI(フェイスリーダーAI)は、こうした「人間の感情」を、顔の筋肉の動きから読み取り、数値化・分類して解析するAI技術です。

このAIは、心理学者ポール・エクマンらによって確立された「顔面動作符号化システム(FACS)」に基づいて構築されています。

従来の顔認識とは異なり、個人の識別ではなく“感情の検出”に特化している点が最大の特徴。

表情の奥にある心理状態をリアルタイムで解析することで、教育、医療、マーケティングなど幅広い分野に革命をもたらそうとしています。

Face Reader AIはどのように感情を「検出」しているのか?

AIと画像認識モデルで進化する表情データ解析

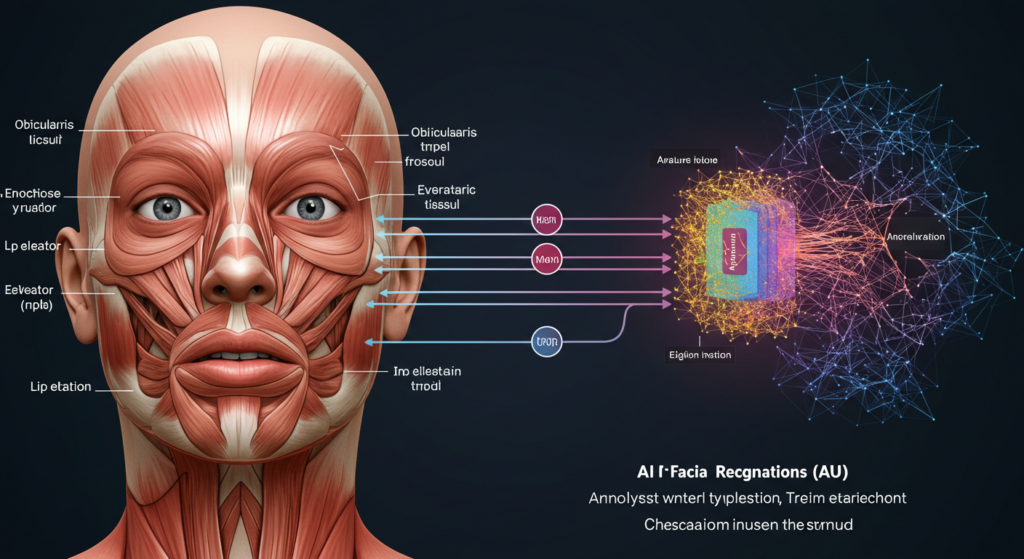

Face Reader AIが感情を捉えるメカニズムは、極めて科学的です。

まず、顔を「眉」「瞼」「口角」「頬」などの筋肉群ごとに分解し、それぞれの動きを「AU(Action Unit)」という記号で分類。

FACS理論においては、このAUが44種に体系化されており、

- AU1:眉の内側を上げる

- AU6:頬を上げる

- AU12:口角を引き上げる

など、1つの動きが複数の筋肉にまたがって構成されていることもあります。

Face Reader AIは、こうしたAUをリアルタイムで検出し、怒り・悲しみ・驚き・喜びなどの感情カテゴリにマッピングします。

この技術の核には、CNN(畳み込みニューラルネットワーク)などのディープラーニングによる画像モデルが使われています。

さらに、近年の研究(Frontiers in Computer Science 2024)では転移学習(Transfer Learning)の導入により、

「表情画像が少ない人物においても高精度な感情分析が可能になる」手法が開発されています。

Image / Photo / 画像データの重要性

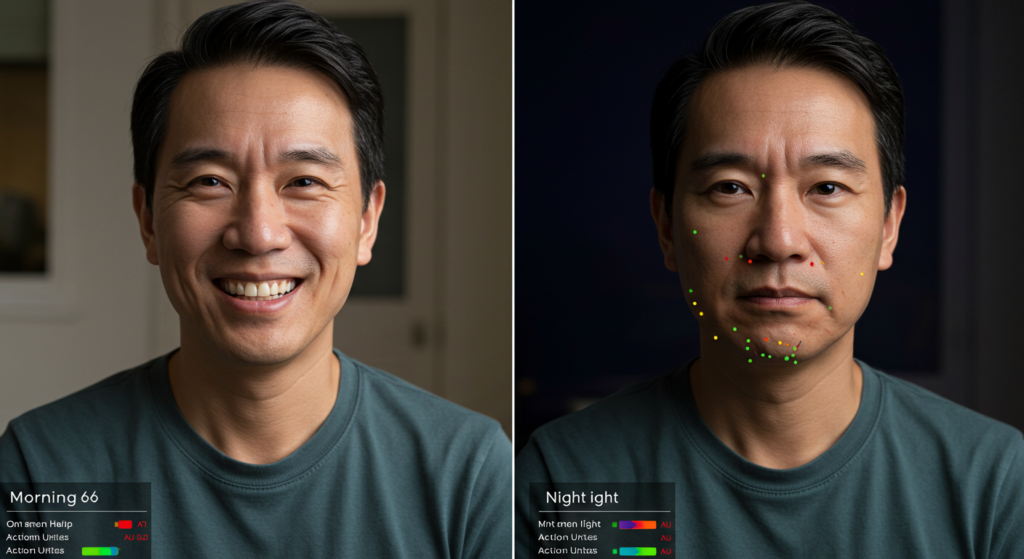

Face Reader AIは「画像」から表情を読み取るため、Image / Photo / 写真の質と構図が極めて重要になります。

- 顔が正面を向いている

- 適度な照明環境

- 表情の変化がはっきり出る映像

といった条件がそろうほど、精度は上がります。

動画ファイル(MP4など)やリアルタイムWebカメラの映像からも感情を分析可能で、静的な写真だけでなく動的データとの連携も進んでいます。

感情分析はどこで使われているのか?導入事例を紹介

Facial表情認識とUX・マーケティングの融合

感情解析は、ユーザー体験(UX)とビジネス成果を向上させる「可視化された声」として機能します。

- 顧客が広告動画を見た際の表情データを分析して、感情のピークや離脱ポイントを把握

- 店舗の接客で顧客のリアクションをリアルタイムに可視化

- テストマーケティングで、「言語化されない感情」をデータとして取得

これにより、従来のアンケートやインタビューでは把握できなかったインサイトを獲得できるのです。

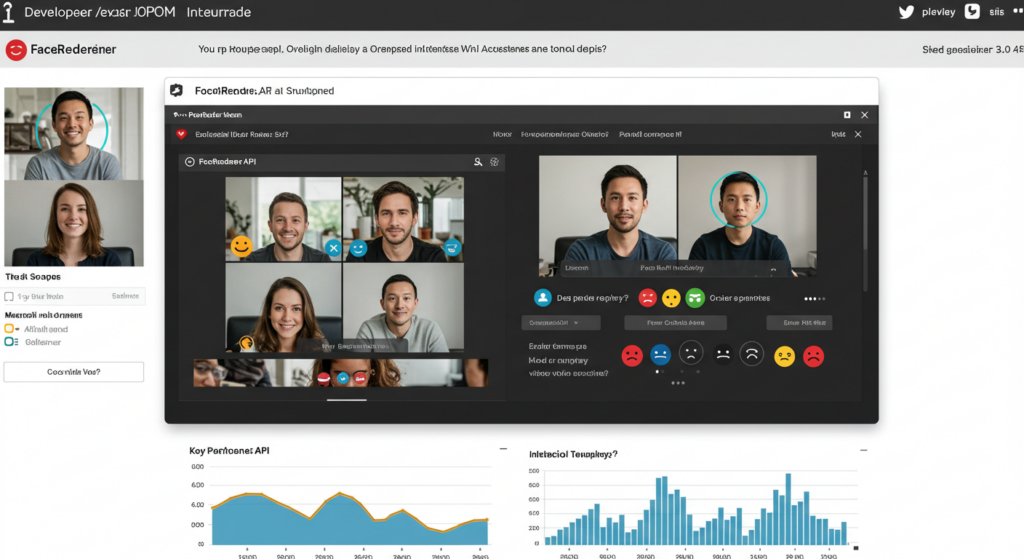

API / アプリ / 機能の拡張とOnline活用

Face Reader AIは、APIとして他サービスに組み込むことが可能です。

- RESTful API(PythonやJavaScriptで実装可能)

- Webアプリ型でOnline(オンライン)上から利用できる

- スマートフォンでも表情データの取得が可能(アクセス制限を超えた応用範囲)

実際にNoldus社の「FaceReader」シリーズや、Affectivaの「Affdex」、CACの「心sensor」シリーズでは、リアルタイムAPI接続による映像解析が実現しています。

さらに、ZoomやMicrosoft Teamsと統合し、Web会議中の感情可視化を行うプロダクトも登場。

これにより、リモート環境でも非言語的フィードバック(感情・集中度・理解度)を把握できるようになっています。

personality(性格)を可視化するFace Reader AI

Face Readerは、瞬間的な表情だけでなく表情の“癖”や“傾向”から、性格や感情パターンを抽出する可能性も秘めています。

- 早稲田大学・菅原氏の研究では、日常的な感情表現の偏りが、顔立ちや印象に影響する可能性が示されました。

- 朝と夜の開眼度の違いから、覚醒度と筋肉活動の関連性も立証されており、健康管理や印象管理への応用が期待されます。

「感情の傾向 × 視覚的変化」=自己ブランディングツールとしての展開もあり得るのです。

Face Reader AIが拓く新ビジネス領域

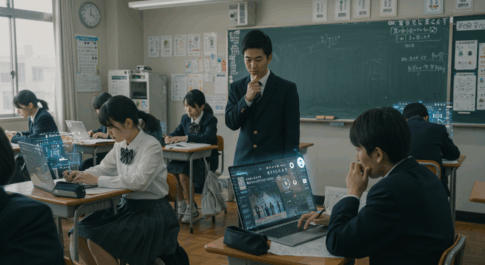

教育・医療・リクルート領域での応用と成果

- 教育現場:学習者の集中度・覚醒度をリアルタイムで可視化 → eラーニングやオンライン授業に革命

- 医療現場:うつ傾向や認知症の初期症状を「顔の微表情」から検出

- 採用面接:表情と声の分析から「緊張度」「誠実さ」などを補足的に評価(例:『カチメン!』)

いずれもFace Reader AIが人間の非言語情報を読み解く力を最大限に活かしています。

食品・美容・ペット領域の展開

- 食品の好みを「表情から逆算」して最適レシピを提案する

- スキンケアやメイクアップで、「魅力を引き出す表情の習慣」を可視化

- ペットの顔表情を読み取り、気分やストレス状態を翻訳

これらの領域では、表情という“非言語の感情データ”が商品開発やUXに直結します。

導入に向けた実践ステップと注意点

1. まずは実用度と分野適合性を調査せよ

FACSは心理学ベースの手法ですが、すべての分野で成熟しているわけではありません。

対象とする産業での研究・導入実績の有無を確認しましょう。

2. 専門人材の確保:FACSコーダーとの連携

FaceReaderの精度を活かすには、FACSの専門資格を持つ分析者(認定FACSコーダー)との連携が望ましいです。

国内には少数精鋭の専門家しかいないため、セミナーや研究会などでネットワーク構築が重要です。

まとめ:Face Reader AIは「無意識の感情」を翻訳する新しい言語だ

Face Reader AIは、感情という「曖昧で主観的な情報」を数値化し、共有可能なデータに変換するツールです。

それはまさに「表情の翻訳機」とも呼べる存在。

今後、テキスト・音声・映像が統合されていくAIコミュニケーション社会において、FaceReaderのような表情解析AIはインターフェースの核心となっていくでしょう。

ぜひ今、あなたのビジネスや研究にもこの技術を取り入れてみてください。

そこに浮かび上がる「新しい表情」が、次のイノベーションを引き出すかもしれません。

引用元情報:

- Noldus Blog「The 5 best ways to use FaceReader」

- PubMed「Facial expression recognition using deep learning and FACS」

- Frontiers in Computer Science「Emotion recognition using FACS and transfer learning」